Internacionales

Cómo evitar las «alucinaciones» o fallos de la IA

Published

3 años agoon

By

LA REDACCIÓNAGENCIA EFE

La incertidumbre sobre la precisión de sus respuestas genera preocupación tanto en usuarios, como en investigadores y empresas que ofrecen estos servicios.

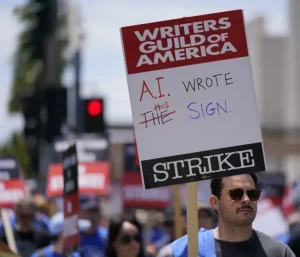

Nueva York, EE.UU.-Una de las mayores taras de los chatbots con inteligencia artificial (IA) generativa es que a veces dan respuestas bien estructuradas pero completamente incorrectas -que pueden ir desde un dato erróneo a una perturbadora conversación-, lo que se conoce en la industria de la tecnología como «alucinaciones», y los expertos se enfrentan ahora al reto de erradicarlas.

Nueva York, EE.UU.-Una de las mayores taras de los chatbots con inteligencia artificial (IA) generativa es que a veces dan respuestas bien estructuradas pero completamente incorrectas -que pueden ir desde un dato erróneo a una perturbadora conversación-, lo que se conoce en la industria de la tecnología como «alucinaciones», y los expertos se enfrentan ahora al reto de erradicarlas.

Desde que se popularizó esta tecnología el otoño pasado, millones de personas han comenzado a usar a diario estos chats para tareas como escribir un correo electrónico, organizar sus vacaciones, buscar información o aprender sobre temas específicos.

No obstante, la incertidumbre sobre la precisión de sus respuestas genera preocupación tanto en usuarios, como en investigadores y empresas que ofrecen estos servicios.

DE RESPUESTAS PERTURBADORAS A OTRAS INVENTADAS

Son varios los ejemplos de este tipo de alucinaciones, y entre las más conocidas están las conversaciones que varias personas tuvieron en febrero con «Sydney», el alter ego de Bing, al poco del lanzamiento del Chatbot de Microsoft.

En uno de los casos, «Sydney» confesó a un periodista del New York Times que le gustaría ser humano, que deseaba ser destructivo y que estaba enamorado de la persona con la que estaba chateando.

Otra de las «alucinaciones» más sonadas fue la del chatbot de Google, Bard, que produjo un vídeo promocional con un error sobre el telescopio espacial James Webb.

Ninguna empresa parece librarse de los patinazos: el chatbot de OpenAI, ChatGPT, indujo al error a un abogado, al crear para él una serie de supuestos precedentes legales totalmente inventados que el abogado usó posteriormente en un juicio, pero fue detectado y ahora se enfrenta a posibles sanciones.

SIN «ALUCINACIONES» TAMPOCO HAY CREATIVIDAD

La IA generativa funciona gracias a un complejo algoritmo que analiza la forma en que los humanos juntan palabras tomando como base la enorme cantidad de información que hay en Internet, pero no está programada para decidir si sus respuestas son verdaderas.

Estas «alucinaciones» no son tan fáciles de erradicar, ya que son parte del mismo sistema que permite a los bots ser creativos y generen conversaciones o historias no repetidas. Es decir, si se quita o frena esta característica de la IA no sería tan fácil que el chat genere poemas en cualquier estilo, cree chistes o sugiera ideas.

“Estas alucinaciones son particularmente problemáticas cuando se requiere un razonamiento de varios pasos, ya que un solo error lógico es suficiente para descarrilar una solución mucho más grande”, detalla en un estudio OpenAI -empresa detrás de la tecnología de los chats de Bing y ChatGPT.

Microsoft y Google, los dos grandes gigantes tecnológicos que compiten en la carrera por ser la compañía referente de los chatbots con IA, han ensayado medidas para intentar evitar estos errores; Microsoft ha probado a limitar el número de preguntas que Bing puede contestar, tras detectar que las «alucinaciones» más distópicas solían aparecer en conversaciones más largas.

Por su parte, cuando Google genera resultados de búsqueda utilizando su tecnología de chatbot, a la vez ejecuta una búsqueda en su buscador tradicional; compara las respuestas obtenidas por las dos tecnologías y si la respuesta no es la misma, el resultado de la IA ni siquiera se muestra.

Esto hace que su chatbot sea menos creativo, por lo que no es tan bueno como sus competidores para escribir poemas o tener conversaciones, pero está menos expuesto al error.

“Nadie en el campo (de la IA generativa) ha resuelto todavía los problemas de las ´alucinaciones´. Todos los modelos tienen este problema”, dijo el director ejecutivo de Google, Sundar Pichai, en una entrevista con CBS en abril.

DOS CHATBOTS MEJOR QUE UNO

Una de las soluciones que propone el estudio titulado: «Mejorando la facticidad y el razonamiento en los modelos de lenguaje a través del debate multiagente», del Instituto de Tecnología de Massachusetts (MIT), es hacer que, antes de responder a un humano, varios chatbots «debatan» entre sí sobre cuál es la respuesta correcta.

Si los chatbots producen múltiples respuestas a la misma pregunta deben primero llegar a un acuerdo sobre cuál es la correcta.

Por su parte, un grupo de investigadores de Cambridge señalan en su artículo «SelfCheckGPT: Detección de alucinaciones de caja negra sin recursos para modelos generativos de lenguaje (LLM)» que una técnica que ayuda a que la IA se equivoque menos es hacerle al mismo chatbot la misma pregunta varias veces para ver si la respuesta es siempre la misma -en ese caso sería correcta- o no.

Otros expertos como Geoffrey Hinton, quien fue bautizado como el «padrino» de la IA y tuvo parte de su carrera en Google, creen que las «alucinaciones» se controlarán para que sean menos frecuentes, pero que no hay manera de deshacerse por completo de ellas.

Internacionales

“Si cruzan el río, serán enjuiciados”: altavoces alertan a migrantes en travesía para entrar a EEUU

Published

1 semana agoon

marzo 22, 2026 Texas, Estados Unidos.-“Atención: el río es una zona militarizada. Una regla de seguridad, de propiedad de defensa, que prohíbe la entrada por el río. Entrando por esta área constituye una violación de esta regla. Si cruzan el río, estarán entrando ilegalmente y serán enjuiciados”.

Texas, Estados Unidos.-“Atención: el río es una zona militarizada. Una regla de seguridad, de propiedad de defensa, que prohíbe la entrada por el río. Entrando por esta área constituye una violación de esta regla. Si cruzan el río, estarán entrando ilegalmente y serán enjuiciados”.

La advertencia irrumpe en el silencio del amanecer. Se transmite desde altavoces de alta potencia instalados en puntos estratégicos del Valle del Río Grande, en el sur de Texas. Su alcance es tal que puede escucharse desde territorio mexicano, a varios kilómetros de distancia.

El mensaje se repite cada minuto, sin parar. Su propósito es frenar a quienes intentan cruzar de manera irregular la frontera sur entre Estados Unidos y México.

Es jueves. Son las 7:11 de la mañana en Granjeno, Texas. El sol aún no sale. Un grupo de periodistas latinoamericanos, acompañado por agentes migratorios, observa uno de estos altavoces durante un recorrido por la frontera sur.

“Por aquí cruzan muchos (migrantes)”, dice la oficial Susana González, especialista de la Oficina Asuntos Públicos de la Patrulla Fronteriza.

Frontera sur de Estados Unidos.Sauro Scalella/ LD

Los altavoces están instalados en torres verticales sobre pequeños remolques.

Además de emitir ese tipo de alertas, las torres también funcionan como sistemas de rescate. Con solo presionar un botón rojo, se activa una señal hacia la Patrulla Fronteriza, mientras una voz automatizada responde en 10 idiomas —entre ellos español, inglés, mandarín y portugués—: “Por favor, mantenga la calma. La ayuda está en camino. Es importante que no se vaya”.

En total, hay 79 torres desplegadas en el sector, según datos oficiales.

El sistema está diseñado para asistir a cualquier persona en peligro, especialmente migrantes que enfrentan situaciones críticas como la deshidratación. En lo que va de 2026, la Patrulla Fronteriza ha encontrado al menos 15 cuerpos a lo largo del valle, una cifra que ya supera la registrada en todo el año fiscal 2025, cuando se localizaron ocho.

El sector del Valle del Río Grande ha sido durante muchos años uno de los principales puntos de entrada para migrantes provenientes de Centroamericana y Sudamérica.

Hace apenas tres o cuatro años, la Patrulla Fronteriza detenía entre 2,000 y 3,000 personas al día en esta zona, explica Rod Kise, portavoz de la Oficina de Asuntos Públicos de la agencia federal en ese sector.

Hoy, el panorama es distinto.

Tras el endurecimiento de las políticas migratorias impulsadas por el presidente Donald Trump, el flujo ha disminuido drásticamente.

El muro que construye la gestión del presidente Donald Trump es más alto y robusto que los anterioressauro scalella/ld.

“Ahora estamos viendo entre 50 y 70 migrantes diarios”, señala Kise. “Desde que esta administración comenzó, los números han bajado considerablemente”.

Aun así, el Valle del Río Grande continúa siendo el sector con mayor número de detenciones. En lo que va del año fiscal, las autoridades han arrestado a 5,832 migrantes en esta área, según cifras de la Oficina de Aduanas y Protección Fronteriza (CBP). La mayoría proviene de México.

Entre ellos, también hay dominicanos: al menos 28 han sido detenidos en el año fiscal 2026 tras intentar cruzar ilegalmente las aguas del río Bravo, según Kise.

Los periodistas también recorren un tramo abierto en la ribera del río Bravo, justo debajo del puente internacional McAllen-Hidalgo, que conecta con Reynosa, en Tamaulipas, México.

El paisaje es rural: hierba alta, matorrales y un camino marcado que desemboca en el río por donde migrantes ya han cruzado irregularmente, según las autoridades. En el suelo quedan rastros de ese cruce silencioso.

“Podemos observar aquí un poco de basura. Lo que normalmente las personas cargan: agua, algún tipo de comida, sueros. Esta es basura que queda de toda la actividad (migratoria) que vemos aquí”, explica González, mientras ilumina el área con un foco.

Susana González, especialista de la Oficina Asuntos Públicos de la Patrulla Fronteriza.Sauro Scalella/LD.

Al otro lado de la orilla, ya en territorio mexicano, González señala que, aunque algunas personas aparentan estar pescando o simplemente pasando el rato, en muchos casos “están vigilando el movimiento” de los agentes para “informar si va a cruzar un grupo” de migrantes.

Quienes logran cruzar el río Bravo se enfrentan a otro desafío. Del otro lado les espera un terreno seco y difícil, lleno de plantas con espinas y animales salvajes como víboras, insectos, garrapatas e incluso ocelotes.

En medio de ese entorno, los agentes de la Patrulla Fronteriza buscan señales que indiquen por dónde han pasado los migrantes. González lo explica: “Nos enfocamos en las ramitas de los árboles. Si está rota en una dirección. Son detalles que son parte de nuestro entrenamiento y los vamos mejorando día a día”.

Las huellas también son importantes. Por la forma y lo recientes que se vean, los agentes pueden saber si alguien pasó por algún lado hace poco. Pero muchos migrantes intentan evitar ser detectados colocando cartón en la suela de sus zapatos, para no dejar marcas en el suelo.

El río, sin embargo, cuenta con sensores de movimiento y gran parte del valle está cubierto por cámaras de vigilancia que operan las 24 horas. A esto se suma un sistema de monitoreo constante.

“Desde el primer nivel contamos con sensores a lo largo del monte que mandan la señal (de movimiento). Otro nivel viene siendo el sistema de cámaras ubicadas (por ejemplo) en el puente. También tenemos las torres (de vigilancia). Y también contamos con asistencia de helicópteros”, detalla González.

A nivel general, en todas las zonas fronterizas, las autoridades estadounidenses han detenido 27,879 migrantes durante el presente año fiscal, de los cuales 18,900 son mexicanos.

La visita de los reporteros internacionales formó parte de un programa de cobertura sobre inmigración organizado por el Departamento de Estado estadounidense y la firma de periodismo Inquire First, que se extendió por una semana.

Internacionales

Israel dice haber atacado instalaciones de producción de armas y cuarteles en Teherán

Published

1 semana agoon

marzo 22, 2026«Las Fuerzas de Defensa de Israel (FDI) continúan intensificando su impacto operativo en los sistemas y capacidades militares del régimen», recoge el comunicado castrense.

El Ejército asegura que, entre las instalaciones atacadas, se encuentra una base militar iraní utilizada para el entrenamiento de soldados; una instalación de producción y almacenamiento de armas del Ministerio de Defensa y al menos un cuartel general del Ministerio de Inteligencia iraní.

Impacto de los ataques en Tel Aviv

En lo que va de domingo, Irán ha lanzado al menos siete oleadas de ataques con misiles que han afectado sobre todo el área metropolitana de Tel Aviv (centro del país), con la caída de fragmentos y munición de racimo en carreteras, un edificio residencial y un coche, confirmó el Ejército a EFE e informaron los equipos de emergencias.

Estos ataques han causado un herido moderado y otros 14 leves, según informó el Magen David Adom, el servicio de Emergencias de Israel (MDA).

Internacionales

Irán amenaza con cerrar por completo el estrecho de Ormuz si EEUU ataca centrales eléctricas

Published

1 semana agoon

marzo 22, 2026Agencia AFP

Teherán, Irán.-El ejército de Irán amenazó el domingo con cerrar por completo el estratégico estrecho de Ormuz si el presidente estadounidense Donald Trump ataca las plantas eléctricas del país.

Teherán, Irán.-El ejército de Irán amenazó el domingo con cerrar por completo el estratégico estrecho de Ormuz si el presidente estadounidense Donald Trump ataca las plantas eléctricas del país.

Irán prácticamente ya ha cerrado esta estratégica vía marítima, pero un número relativamente reducido de buques ha podido transitar por allí, alrededor de un 5% de su volumen previo a la guerra, según la empresa de análisis Kpler.